DeepInfra

AI開発者ツールオープンソースAIモデルを超低コスト・高速で提供する推論プラットフォーム。主要モデルを業界最安値水準のAPI料金で利用可能。

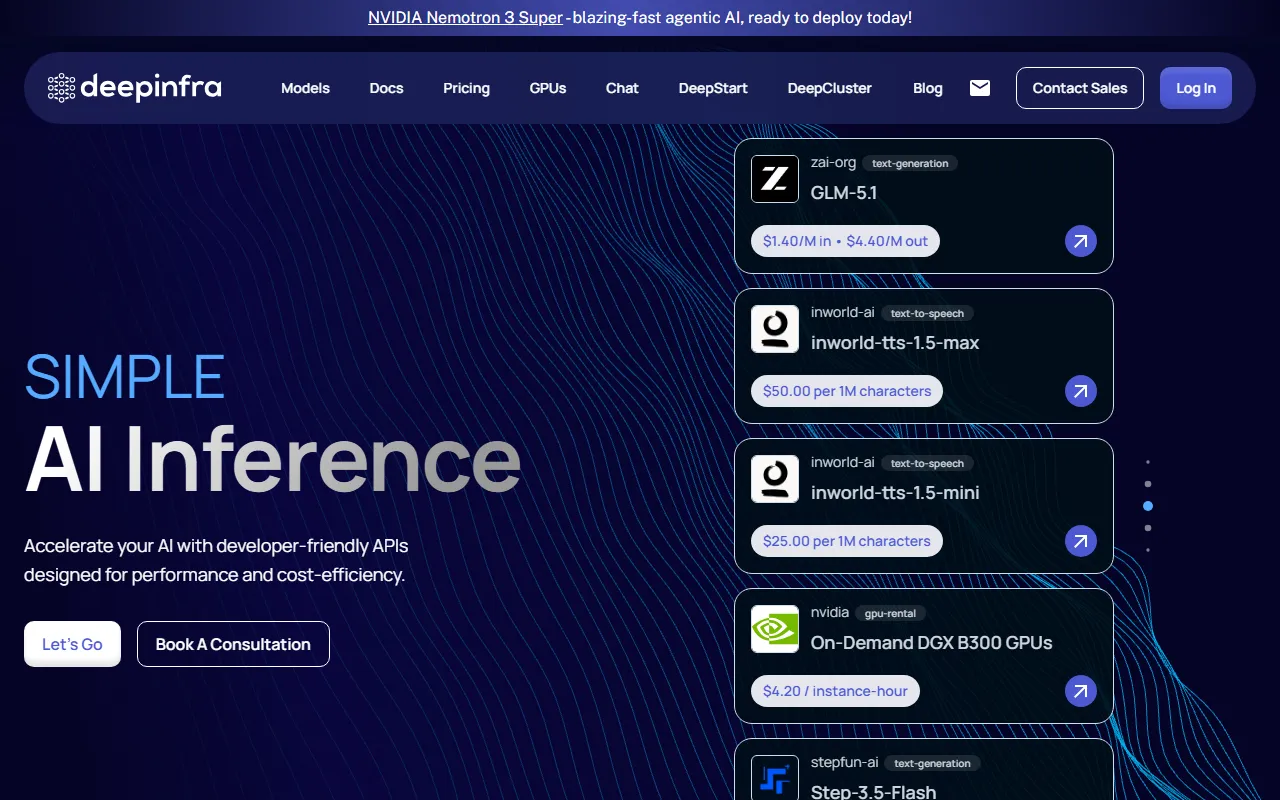

DeepInfraとは?

DeepInfraは、オープンソースAIモデルの推論を超低コスト・高速で提供するクラウドプラットフォームです。独自のインフラ最適化により、Llama、Mistral、DeepSeek、Qwen等の主要オープンソースモデルを、業界最安値水準の料金で提供しています。コスト効率を最優先するAI開発者にとって最も魅力的な選択肢の一つです。\n\nDeepInfraの強みは、徹底したコスト効率です。例えばLlama 3.3 70Bの推論料金は$0.12/100万トークンと、他の主要プロバイダーと比較して大幅に低い価格設定です。この低コストは、GPUの効率的な共有、モデルの量子化、推論エンジンの最適化によって実現されています。大量のAPI呼び出しが発生するプロダクション環境では、この価格差が月々の運用コストに大きく影響します。\n\nOpenAI互換APIを提供しているため、既存のコードからの移行は非常に簡単です。テキスト生成、エンベディング、画像生成(Stable Diffusion等)、音声認識(Whisper等)など幅広いモデルに対応しており、ファインチューニング機能も提供しています。無料枠も用意されているため、まずは無料で試して本番導入を検討するフローが一般的です。

料金プラン

主な機能・特徴

メリット・デメリット

メリット

- ●業界最安値水準のAPI料金

- ●OpenAI互換APIで移行が容易

- ●主要オープンソースモデルを幅広くサポート

- ●無料枠で気軽に試用可能

デメリット

- ●Groqほどの推論速度は出ない場合がある

- ●クローズドモデルは利用不可

- ●SLAやカスタムサポートはエンタープライズプランのみ

よくある質問(FAQ)

Q. DeepInfraはなぜこんなに安いのですか?

A. GPU共有の効率化、モデルの量子化、推論エンジンの独自最適化により、1リクエストあたりのGPUコストを最小限に抑えています。大規模なインフラをベースにしたスケールメリットもコスト削減に貢献しています。

Q. 本番環境での利用に耐えますか?

A. はい、多くのスタートアップや中規模企業がプロダクション環境でDeepInfraを利用しています。ただし、ミッションクリティカルな用途では、エンタープライズプランのSLA保証を検討することを推奨します。

関連ツール

Groq

独自のLPUチップで世界最速のAI推論を実現するクラウドプラットフォーム。Llama、Mistral、Gemmaなどのオープンソースモデルを超高速で実行可能。

OpenRouter

複数のAIモデルを統一APIで利用できるモデルルーター。GPT-5、Claude、Gemini、Llama等300以上のモデルを1つのAPIキーで切り替え可能。

Together AI

オープンソースAIモデルの高速推論・ファインチューニングプラットフォーム。Llama、Mistral、SDXL等を低コストで利用可能。

Vercel AI SDK

VercelのオープンソースAI開発キット。React/Next.jsでAIアプリケーションを簡単に構築。ストリーミングUI、マルチモデル対応。

Anthropic Console

Anthropicが提供するClaude API管理プラットフォーム。Claude Opus 4.6/Sonnet 4.6/Haiku等の最新モデルをAPI経由で利用し、プロンプト管理・テストを行える。

xAI Grok Console

xAI(イーロン・マスクのAI企業)が提供するGrokモデルのAPI開発プラットフォーム。Grok-3等のモデルをAPI経由で利用可能。